LLMs in der Cybersicherheit: Fluch oder Segen?

LLMs in der Cybersicherheit: Fluch oder Segen?

Seit drei Jahren beschäftigt sich unsere Gesellschaft mit einer zentralen Frage: Welche Folgen bringt die rasante Entwicklung der Künstlichen Intelligenz, insbesondere der sogenannten „grossen Sprachmodelle“ (Large Language Models, LLMs)? Was wird aus unseren Kindern, wenn sie in der Schule von oder mithilfe von LLMs lernen? Wie verändern LLMs das Leben älterer Menschen?

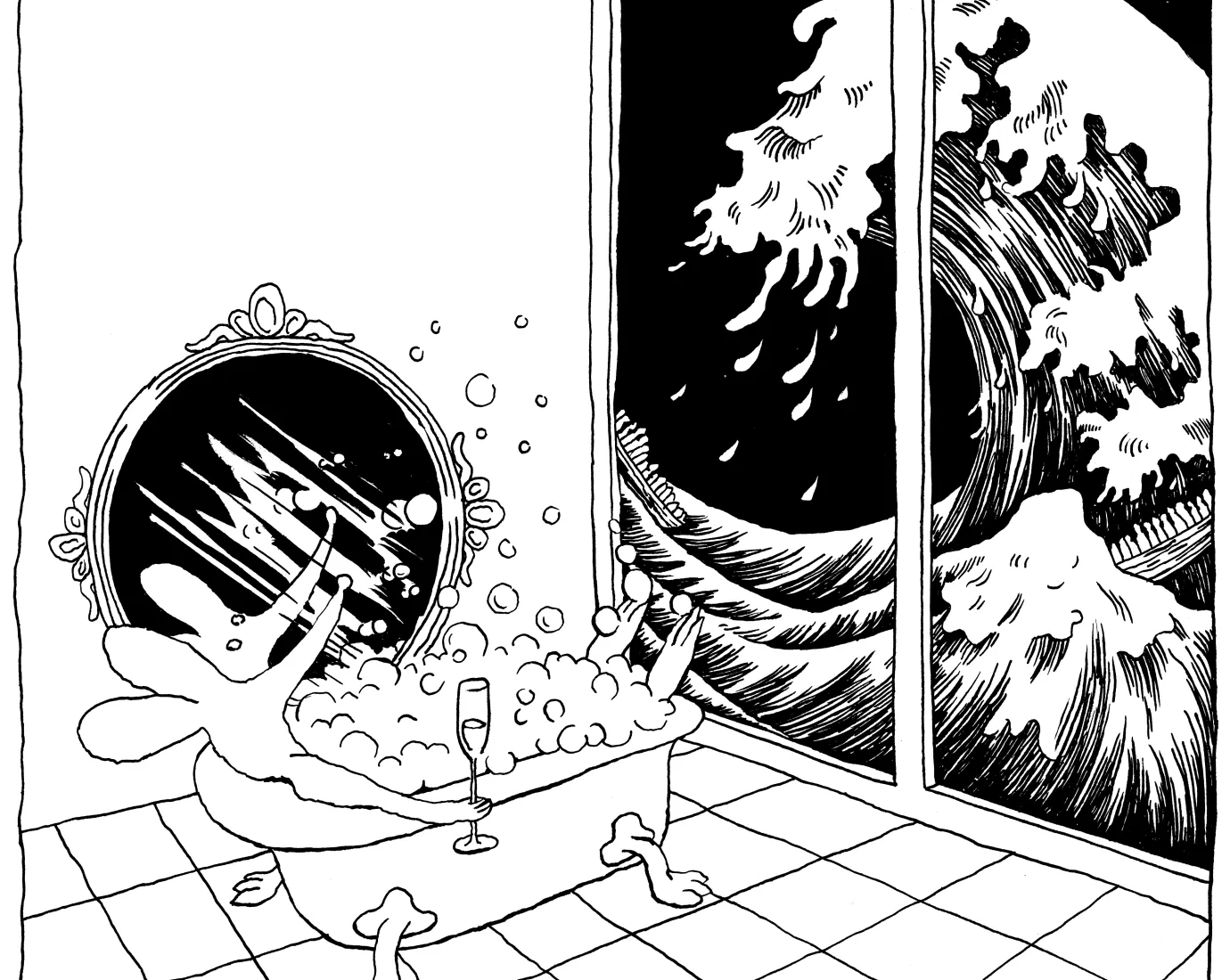

Und auch im Bereich der digitalen Sicherheit stellt sich diese Frage: Werden LLMs hier zum Game Changer – oder flaut der Hype bald ab und „business as usual“ kehrt zurück? Die Antwort scheint klar: Das „Geschäft“ verändert sich auch in der Cybersicherheit grundlegend – wenn auch anders, als viele zunächst vermuten.

LLMs haben sich in kürzester Zeit als Werkzeuge zur Erstellung verblüffend echter Phishing-Mails, gefälschter Vorstandsanrufe, manipulierter Videos und überzeugender Desinformation etabliert. Diese Risiken sind erheblich, aber grundsätzlich beherrschbar. Die eigentliche Machtprobe von LLMs als Cyberwaffe findet jedoch in den „technischen Ecken“ der digitalen Welt statt.

Kernaufgabe der Cybersicherheit ist die Erkennung und Beseitigung von Schwachstellen – also Programmfehlern, die es Unbefugten ermöglichen, unbefugte Befehle auszuführen, Daten zu verschlüsseln oder zu stehlen. Die Identifikation solcher Schwachstellen erfordert ein hohes Mass an technischem Verständnis. Hier bieten LLMs, mit ihrer Fähigkeit, komplexe Fragen zu beantworten und dabei meist nützliche Lösungen zu liefern – Halluzinationen hin oder her – ein hochwirksames Werkzeug zur Produktivitätssteigerung. Für wen? Für alle, die es nutzen – mit welchen Absichten auch immer.

Das gleiche Phänomen zeigt sich bei einer anderen, sehr praxisnahen Aufgabe: beim Hacking. Dabei geht es um die Überwindung tatsächlicher Hürden, die durch Sicherheitsmechanismen geschaffen werden, um die Integrität von IT-Systemen zu schützen. Um das Vorgehen der Angreifer nachzuahmen und entdeckte Probleme rasch zu beheben, werden häufig sogenannte Penetrationstests eingesetzt. Auch hier gilt: LLMs machen solche Vorgänge effizienter und kostengünstiger – allerdings auch für die Angreifer.

Fazit: Am Wettrennen um den technologischen Vorsprung ändert sich auch im Zeitalter der LLMs nichts Grundlegendes. Sicherheit bleibt ein Wettlauf zwischen menschlicher Skrupellosigkeit – und menschlichem Anstand.